《Consciousness in Artificial Intelligence: Insights from the Science of Consciousness》2023.08.22

https://arxiv.org/pdf/2308.08708.pdf

基于神经科学的理论,通过脑电图或磁共振成像检测到的人类大脑内部工作信号,可以得到“人具备意识”的结论。但这套成熟的方法无法用在算法上。于是他们基于认知神经科学的理论和认知,首先从当前的人类意识理论中提取有关有意识状态的核心特征,然后在AI的基础架构中寻找这些特征,以此寻求线索。

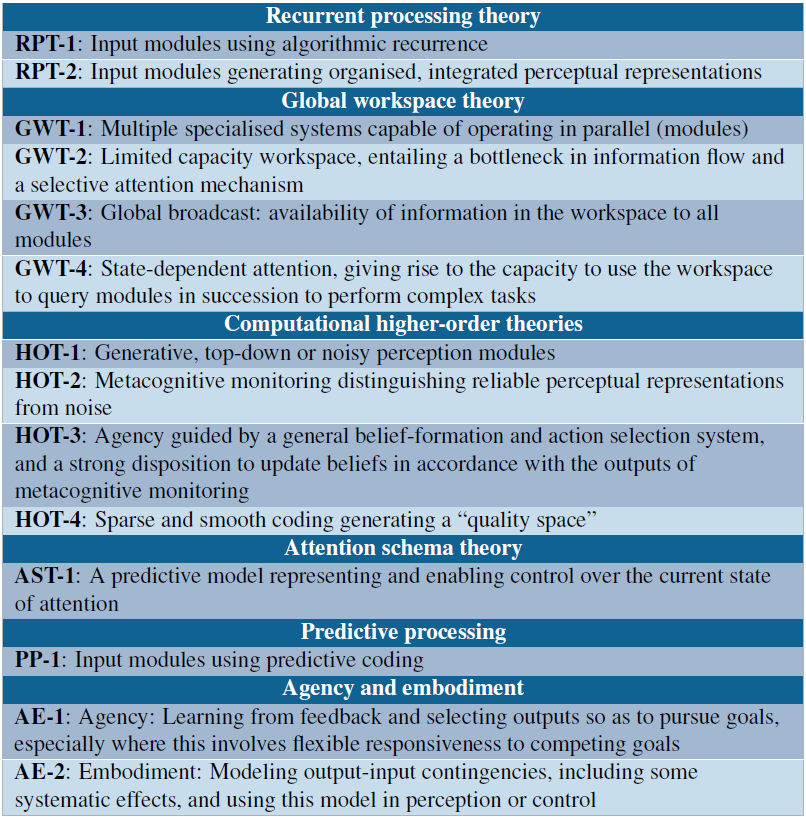

研究团队从当前多种意识相关的理论中提取了具体特征,包括:

1、循环加工理论 (Recurrent Processing Theory, RPT):该理论认为,意识源于大脑通过“反馈循环”将经验传递,利用先前知识和连接来理解当前经验;

2、全局工作空间理论(Global Neuronal Workspace,GNW):理论解释我们的大脑如何协调和处理同时发生的众多信息流。在这一理论中,意识被定义为类似于心理舞台上的聚光灯,决定我们关注什么和忽略什么;

3、高阶理论(Higher Order Thought theory, HOT):这是一组理论,认为意识是对我们的思想和感觉进行实时感知的结果。在这里,意识被定义为能够“思考”;

4、注意图式理论(Attention Schema Theory, AST):该理论解释意识是大脑引导我们的注意力到特定对象、思想、记忆和其他刺激的结果,同时过滤掉其他刺激。这一理论的关键元素是意识到我们的注意力是如何以及在何处被引导的能力;

5、预测加工理论(Predictive Processing, PP):大脑基于过去经验准确预测和解释周围世界的能力。这对于设计能生成创意内容或解决复杂问题的AI模型来说尤为重要;

6、研究团队还制定了根据代理性评估AI的标准(Agency and embodiment),即做出有意识决策的能力,以及根据实体性在物理空间或相对于其他虚拟系统的具体化程度。

基于上述核心意识理论,研究团队制定了14个标准和具体的测量方法,然后按照这个清单评估人工智能模型。一个AI架构能够达到的指标越多,具备意识的可能性就越大。此研究的初衷是引发更多问题和讨论,并为探讨AI模型的意识问题提供一个起点。Robert Long(作者之一,joint first authors):“这项工作为评估越来越具有人类特征的AI提供了一个框架。我们正在引入一种之前缺失的系统性方法。”

测试结果发现,市面上非常多模型在“循环加工理论”这个指标上完成较为出色,而ChatGPT则在“全局工作空间”方面表现突出。但总体来说,纳入测试范围的所有AI模型都只能完成少数几个指标,由此得出没有某一个模型能够形成自我意识。一方面,结果说明了现阶段的AI能力或许还没到能够形成意识的阶段;另一方面,在人为制造、训练AI模型的过程中,开发者并不会有意让AI全方面形成这些认知能力。Eric Elmoznino(作者之一):“之所以没有人这样做,是因为目前尚不清楚它们对于任务是否有用。”

https://mp.weixin.qq.com/s/VfUM_y7DdShHwhbrdkzoqA

https://mp.weixin.qq.com/s/o30Hm0VlP9_glYf-KkDr8Q

2012年,科学家们发表了《剑桥意识宣言》,指出有足够的证据可以推断“所有哺乳动物和鸟类,以及包括章鱼在内的许多其他生物”都经历过有意识的状态:没有新皮质(neocortex)似乎并不妨碍生物体体验情感状态。综合证据表明,非人类动物具有意识状态的神经解剖学、神经化学和神经生理学基础,并有能力表现出自主行为(intentional behaviours)。《宣言》使用了“意识状态的基础”(substrates of conscious states)一词,这意味着关于意识的来源已经有了确定的发现。《宣言》确定了新的五个意识标志,拥有其中一些标志足以证明意识的存在:同源脑回路(homologous brain circuits);人工刺激脑区,在人类和其他动物身上引起相似的行为和情感表达;支持注意力、睡眠和决策等行为或电生理(electrophysical)状态的神经回路;镜像自我认知;以及致幻药物对不同物种的类似影响。所有这五个标志都是衍生标志,是对人类和高等哺乳动物进行科学研究的结果。

大多数哲学家接受(或倾向于接受)成人有意识(95.15%)、猫有意识(88.55%)、新生儿有意识(84.34%)和鱼有意识(65.29%)。对苍蝇(34.52%)、蠕虫(24.18%)和植物(7.23%)持怀疑态度的人要多很多。39.19%的受访哲学家认为未来的人工智能系统会有意识。请注意,这项调查是在ChatGPT被介绍给大众之前进行的。

https://mp.weixin.qq.com/s/msm_Giw-qgVLhQ7j2m_ygA

Transcript: Noam Chomsky on ChatGPT, AI, Universal Grammar, Language and Mind

诺姆-乔姆斯基谈 ChatGPT、人工智能、普遍语法、语言与思维

August 24, 2023

https://singjupost.com/transcript-noam-chomsky-on-chatgpt-ai-universal-grammar-language-and-mind/?singlepage=1

https://mp.weixin.qq.com/s/wlbGIXov3PfFaRcp5YAnnA

塞缪尔-马鲁斯卡:究竟是什么导致了意识?是大脑中神经元的跳动吗?

诺姆-乔姆斯基:大脑是一个极其复杂的物体,人们对它的了解少之又少。我们可以讨论意识的起因,你可以找出哪些神经结构参与了意识体验。使用的基本模型——神经网络模型,很可能是错误的模型。

就约翰-塞尔的“中文屋”论点而言,当房间并不思考时,我们使用“思考”这个词的方式,就好比问潜艇会不会游泳。维特根斯坦说,人会思考,也许玩偶和灵魂也是(people think, maybe dolls and spirits)。“思考”是我们用来形容人的行为的一个词。它有开放的构造(open texture)。我们可以把它用在类似人的事物上,但这本质上只是术语。

AI所做的是扫描大量数据,找出统计规律性,以便能合理猜测某个序列中的下一个词是什么。这是思考吗?潜水艇会游泳吗?这是同样的问题。

关于塞尔的“中文屋”

《心智探奇:人类心智的起源与进化》史蒂芬·平克

第一部分 心智理论的前世今生

02 心智计算理论

塞尔下结论说,意图性、意识及其他心理现象不是由信息处理所导致的,它们是由“真实人脑的真实物理-化学性质”导致的(尽管他从没说过这些性质到底是什么)。对于人们说整个屋子(人加上规则清单)懂中文,塞尔回答:那好,让这人生记住这些规则,在脑袋里做运算,到户外去工作。屋子没了,而我们的符号操控者仍旧不懂中文。

哲学家帕特里西娅(Patricia)和保罗·丘吉兰德(Paul Churchland)请我们想象一下塞尔的论证应用到反驳麦斯维尔的“光是由电磁波组成的”理论的。一个人手里拿着块磁石上下挥舞,这个人在创造电磁辐射,但却没有光发出来,所以,光不是一种电磁波。这个假想实验将波幅放慢,以至我们用肉眼无法把它们再看作是光。由于相信我们在假想实验中的直觉,我们错误地得出结论,认为速度快的波也不可能是光。与之类似,塞尔将心智计算速度放慢到我们人类不再认为是理解的幅度(因为理解通常是要快得多的)。由于相信我们在假想实验中的直觉,我们错误地得出结论,认为快速计算也不可能是理解。但假设一个加速版的塞尔的荒谬故事能够变为事实,我们碰到一个似乎能够智能地使用中文谈话的人,但他实际上是在远不到一秒的时间里应用了数百万个记忆的规则,这时我们该不该否认他懂中文呢?

我自己的观点是,塞尔只是在探究有关英文单词“理解”的事实。人们不大愿意使用这个词,除非满足了一定的刻板印象条件:迅速而无意识地运用语言规则,且语言的内容与整个人的信念有联系。如果人们避免使用日常的单词“理解”,而去接受那些违背了刻板印象但仍保留着这个现象核心的奇异条件,那么从科学上讲,确实没什么大不了的。我们可以再找另外一个词,或是使用一种技术意义上的旧词,谁会在乎呢?对“如何算是理解”的解释是一样的。毕竟,科学是关于事物运转的原则,而不是关于哪些事物是一个熟悉的词的“真正”例子。至于脑的“物理-化学性质”,我已经提到过这个问题:脑肿瘤、鼠脑以及放在试碟里仍然存活的神经组织切片都不能“理解”,但它们的物理-化学性质和我们脑中的一样。心智计算理论解释了这种差异:那些神经组织肉坨没有被布置成执行正确信息处理的连接模式。

李新宇 《人工智能的“智能”是什么?— 智能的原理》

https://mp.weixin.qq.com/s/eT50oBeKHGc6BFjo-ziZJQ

https://mp.weixin.qq.com/s/vZHr8ldkPP_tXXzlnXQHFA

霍华德·加德纳的多元智能理论,人类的智能分成七个范畴:1.语言 (Verbal/Linguistic) ,2.逻辑 (Logical/Mathematical) ,3.空间 (Visual/Spatial) ,4.肢体运作 (Bodily/Kinesthetic) ,5.音乐 (Musical/Rhythmic),6.人际 (Inter-personal/Social) ,7.内省 (Intra-personal/Introspective)。

尼尔森(Nils J. Nilsson)《人工智能》绪论:“我认为,理解智能包括理解:知识如何获取、表达和存储;智能行为如何产生和学习;动机情感和优先权如何发展和应用;传感器信号如何转换成各种符号;怎样利用各种符号执行逻辑运算、对过去进行推理及对未来进行规划;智能机制如何产生幻觉、信念、希望、畏惧、梦幻甚至善良和爱情等现象。我相信,对上述内容有一个根本的理解将会成为以拥有原子物理、相对论和分子遗传学等级相当的科学成就。“ ——James Albus ‘答复Henry Hexmoor’”

“元选择体”(或“原智能体”):一个客观实体可以接受M类输入,自身可以做N类的输出,对于任一类输入,这个客观实体会以一定的概率分布在N类输出中选择做出某一类输出,则这个客观实体被定义为元选择体。

第一个从物理上可以观察到的智能特征:智能需要消耗能量。智能必然对环境的信息输入产生自己的动作输出,具有现实意义的智能一定会消耗能量。智能体必然引入负熵。

智能的第二个基本特征,从数学的角度看智能对信息的处理,就是对信息状态数的压缩合并。马毅《On the principles of parsimony and self-consistency for the emergence of intelligence》智能出现的两个重要原则:简约性和自洽性。

结论:只要能构造出元选择体,就可以构造出智能,所以智能并不只是碳基生物才能拥有。机器智能达到和超越人的智能不存在原理上的障碍。

《从维特根斯坦的哲学视角看生成式语言模型与意识的哲学挑战》

https://mp.weixin.qq.com/s/RYMwKUvkwYNlS6ohxl5SEg

维特根斯坦《哲学研究》:“只有对一个活着的人和类似活着的人行为的东西,我们才能说它有感觉……是有意识或无意识的。”这意味着,意识的概念是通过我们对他人行为的观察和互动来理解的,而不是通过内省或自我反思来定义的。生成式语言模型的行为虽然越来越像人类,但它们的“意识”是否可以被视为真实的意识,仍然需要通过与人类的互动和行为表现来判断。

《Simulacra as Conscious Exotica》Murray Shanahan,Google DeepMind

https://arxiv.org/pdf/2402.12422

“意识异国情调”(conscious exotica):内格尔意识的主观体验

https://mp.weixin.qq.com/s/lQxY37nSgMMXpct0rXAkkQ

运动学自我意识(Kinematic Self-Awareness):目标是赋予机器人理解自身、适应环境变化甚至在受损时快速恢复的能力,而无需频繁的人工干预。

论文题目:Teaching robots to build simulations of themselves

发表时间:2025年2月25日

论文地址:https://www.nature.com/articles/s42256-025-01006-w

期刊名称:Nature Machine Intelligence

《计算机、意义和意识》Computers, meaning, and consciousness

https://academic.oup.com/nc/article/2025/1/niaf057/8377180

Robert Worden,主动推理研究所

本文通过简明论证推导出一个否定性结论:计算机无法产生意识。如果大脑仅是神经计算机,则大脑亦无法产生意识。意识的存在意味着大脑中除了计算过程之外还存在其他机制。在运行的计算机中,关于外部事件的信息被编码以实现物理计算,但解码这些信息所需的密钥(例如将电压解读为比特、或将神经元放电序列解读为数字)并不存在于计算机内部。任何计算的意义都未在计算机内部定义,而是由外部实体通过解码结果赋予。若无解码信息,计算机内部并不包含关于外部事件的信息。同理,任何书籍的意义也不在书内定义,阅读书籍需要外部知识作为支撑。意识承载着关于外部事件的有意义信息。如果大脑仅是计算机,在缺乏解码机制(这需要外部信息参与)的情况下,它就无法包含关于外部事件的信息。若大脑仅是计算机,意识便不可能由大脑内部事件实现。此结论与哲学领域关于计算功能主义、表征及意向性的立场进行了对比。大脑中必然存在超越神经计算的其他机制。一种可能的解释是,这种机制可能是对三维空间的模拟建模。模拟模型所包含的信息几乎无需解码即可直接表征。因此,大脑中对现实世界的模拟模型或许正是意识的来源。