河森堡关于AI的一篇微博:https://weibo.com/5992829552/MCeqg2YK5

1、“GPT并行开了12个屏幕的游戏,每个屏幕都以7倍的速度对战,这意味着AI在以近百倍的速度学习反馈”:《黑客帝国》中的学习过程变成真的了。

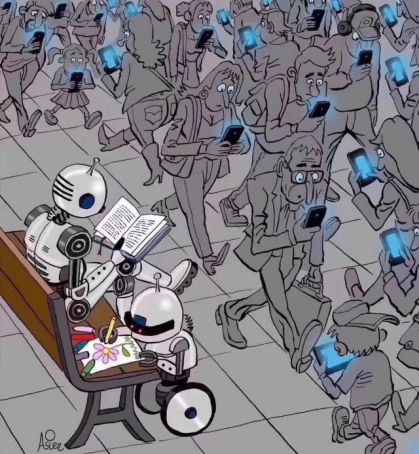

2、AI高水平地做了大量的重复工作,让人有时间、有能力(AI能够做的底层工作就可以固化封装)在更高层面上去探索。同时AI可以极大地提升人类的学习、创新效率(林亦以前几个月做的工作,现在只需要1周时间)。现在还看不到AI完全自主的创新能力。

“ AI不会淘汰人,只会淘汰不会使用AI的人。”

林亦用GPT玩《街霸2》的视频见:https://weibo.com/tv/show/1034:4890912753647738?from=old_pc_videoshow

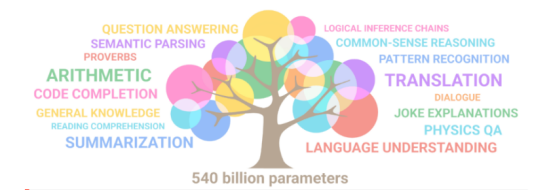

生成式预训练大模型表现出了 “随模型规模增长,学会更多新技能” 的规律。这种前所未有的无师自通是大模型更强通用性的主要来源。

随着参数从 80 亿增长到 5400 亿, Google PaLM 大模型学到了多个新技能。

《AI3.0》

10游戏只是手段,通用人工智能才是目标

哈萨比斯:通用人工智能可以根据自身的经验和数据来学习如何做事。

DeepMind对于其在AlphaGo项目上取得的成果的最为重要的声明:“我们的结果全面地证明了一个纯粹的强化学习方法是完全可行的,即便在最具挑战性的领域,不用人类的示例或指导,除基本规则之外不提供任何其他领域的知识,程序也有可能训练到超人类水平。”

在机器学习领域,有一个充满前景的学习方法,那就是“迁移学习”(transfer learning),它是指一个程序将其所学的关于一项任务的知识进行迁移,以帮助其获得执行不同的相关任务的能力。人类从一种任务到另一种任务的能力迁移看起来毫不费劲,我们对所学知识进行泛化的能力正是思考的核心部分。迁移学习的本质就是学习本身。与人类形成鲜明对比的是,当今人工智能领域中的大多数学习算法在相关的任务之间是不可迁移的。

国际象棋或围棋这样的游戏可以教会人们如何更好地思考:如何进行逻辑思考、抽象推理和战略规划。这些都是能够让人受用一生的能力,也是可以在所有事情中使用的通用能力。AlphaGo并没有学会更好地“思考”除围棋之外的其他任何事情。除了围棋之外,它不具备任何思考、推理和规划的能力。它所学到的能力没有一项是通用的,也没有一项可以被迁移到任何其他任务上。

尽管AlphaGo等深度Q学习系统已经在某些细分领域上取得了超人类的表现,但是它们缺乏一些对人类智能而言非常基本的东西,比如抽象能力、“域泛化”(domain generalization)能力,以及迁移学习能力,如何使系统获得这些能力仍然是人工智能领域最重要的开放问题之一。这些系统并未以人类的方式来学习的另一个原因是:与监督学习系统一样,这些深度Q学习系统极易受到对抗样本的攻击。对输入做出某种人类无法察觉的微小改变会严重损害程序的表现。

扩展:AI需要对“通用的学习能力”进行学习(二阶学习)。现阶段AIGC方面取得了一定的通用能力泛化的进展,但还需要有一个“通用的学习能力”方法的质变的过程(类似于Transformer之与NLP)。

AutoML-GPT: Automatic Machine Learning with GPT

https://mp.weixin.qq.com/s/DGrWcoJv2AQXiL_bNM8z0Q

https://papers.labml.ai/paper/35151be0eb2011edb95839eec3084ddd

二阶神经网络的一个例子:ToT(Tree of Thoughts思维树)

《心智探奇:人类心智的起源与进化》史蒂芬·平克

03 自然选择理论

遗传算法的威力

学习也能指导进化。

心理学家詹姆斯·马克·鲍德温(James Mark Baldwin)曾提出,学习能够以这样的方式指导进化,创造出一种拉马克式进化幻象而无须真的有拉马克式进化。但没有人证明过这个被称为“鲍德温效应”的观点是否真的有效。欣顿和诺兰展示了为什么它能够有效。学习的能力将“从干草垛里寻找针”的进化问题调整为“当你接近了这根针时,会有人告诉你”。

AI预测纯靠拼凑记忆,机器学习实际上并没有学习:人工智能模型主要依赖于回忆现有数据,而不是学习特定的化学相互作用,来预测药物的有效性。

自人工智能发展以来,药物发现研究也越来越多地采用AI相关的技术。比如图神经网络(GNN),适用于预测某种分子与靶蛋白结合的强度。「如果GNN按照预期行事,它们需要学习化合物和靶蛋白之间的相互作用,并且通过优先考虑特定的相互作用来给出预测」。

然而,大多数GNN只学会了一些蛋白质与药物的相互作用,主要集中在配体上。为了预测分子与靶蛋白的结合强度,模型主要「记住」了它们在训练过程中遇到的化学相似分子及其结合数据,而不管靶蛋白如何。这些被记住的化学相似性基本上决定了预测。

研究中也发现了另外一个现象:当测试化合物的效力增加时,模型倾向于学习到更多的相互作用。

论文:

《Learning characteristics of graph neural networks predicting protein–ligand affinities》

https://www.nature.com/articles/s42256-023-00756-9

文章:

《Decoding the Black Box of AI – Scientists Uncover Unexpected Results》

https://scitechdaily.com/decoding-the-black-box-of-ai-scientists-uncover-unexpected-results/

《AI并没有学习!Nature子刊最新研究解码人工智能黑盒》

https://mp.weixin.qq.com/s/oQvc6YmGAqts5L5B2wvhKQ

生物大脑超越反向传播的学习

《Inferring neural activity before plasticity as a foundation for learning beyond backpropagation》

论文地址:https://www.nature.com/articles/s41593-023-01514-1

无论对人类还是机器来说,学习的本质都是要找出信息处理管道中的哪些组件应为输出错误负责——这一挑战被称为 “激励分配”(credit assignment)。长期以来,人们一直认为激励分配最好通过反向传播来解决,这也是现代机器学习的基础。脑中的学习采用一种根本不同的激励分配原则——前瞻性适配(prospective configuration):网络首先推断出学习应该产生的神经活动模式,然后修改突触权重以巩固神经活动的变化。这种不同于反向传播的独特机制是皮层电路模型家族中成熟学习的基础,在生物有机体面临的许多情况下能使学习更有效率、效果更优。

https://mp.weixin.qq.com/s/WUPU2gg_WVbcUAhYXTtraw

《为何AI还不能自学习?如何实现?》

https://mp.weixin.qq.com/s/jsGeJPImU-GahqDT4R2pCg

AI缺乏像人一样学习的能力。儿童从出生起就在学习和行动,他们能灵活选择关注什么、学习什么、何时行动、何时观察,并在不同学习模式间自由切换。AI 难以实现自学习的 4 个结构性困境:

– 高质量文本数据的供给已接近天花板;

– 由于缺乏与环境的真实交互,模型无法学习超越人类现有知识的新内容;

– 过度依赖语言,而忽视了空间感知、具身认知以及对物理世界的扎根推理物理世界中的空间、具身和接地(grounded)推理;

– 模型在部署之后便停止自我改进,无法实现终身学习。

让机器像人一样学习

给出了一套受人类和动物认知启发的学习架构:整合了基于观察的学习(System A)和基于主动行为的学习(System B),并能够根据内部生成的元控制(System M)信号在这些学习模式之间灵活切换。

《Why AI systems don’t learn and what to do about it》March 17, 2026

https://arxiv.org/pdf/2603.15381